Ein Team aus Informatiker*innen der Universität Bielefeld hat in einer Studie untersucht, inwieweit Visualisierungen in Augmented Reality das Verständnis, das Vertrauen und die Akzeptanz von Nutzer*innen gegenüber einem Roboter erhöhen können. Die Ergebnisse finden Eingang in das Forschungsprojekt B05 des Transregios, in dem Erklärungen mittels Visualisierungen gegeben werden sollen.

„Roboter können beispielsweise in der Pflege, der Industrie oder im Haushalt bei grundlegenden Aufgaben unterstützen. Doch damit ein Roboter in der Gesellschaft angenommen wird, müssen wir Nutzer*innen dem Roboter vertrauen können. Und das geht nur, indem wir sie verstehen“, sagt Helen Beierling, wissenschaftliche Mitarbeiterin im Teilprojekt B05 „Erklärbarkeit ko-konstruieren mit einem interaktiv lernenden Roboter“ des Transregios. Gemeinsam mit Projektleiterin Dr.-Ing. Anna-Lisa Vollmer, Robin Helmert und Leonie Dyck von der Arbeitsgruppe „Medizinische Assistenzsysteme“ der Universität Bielefeld hat sie einen möglichen Ansatz getestet, wie die Transparenz eines Roboters erhöht werden kann.

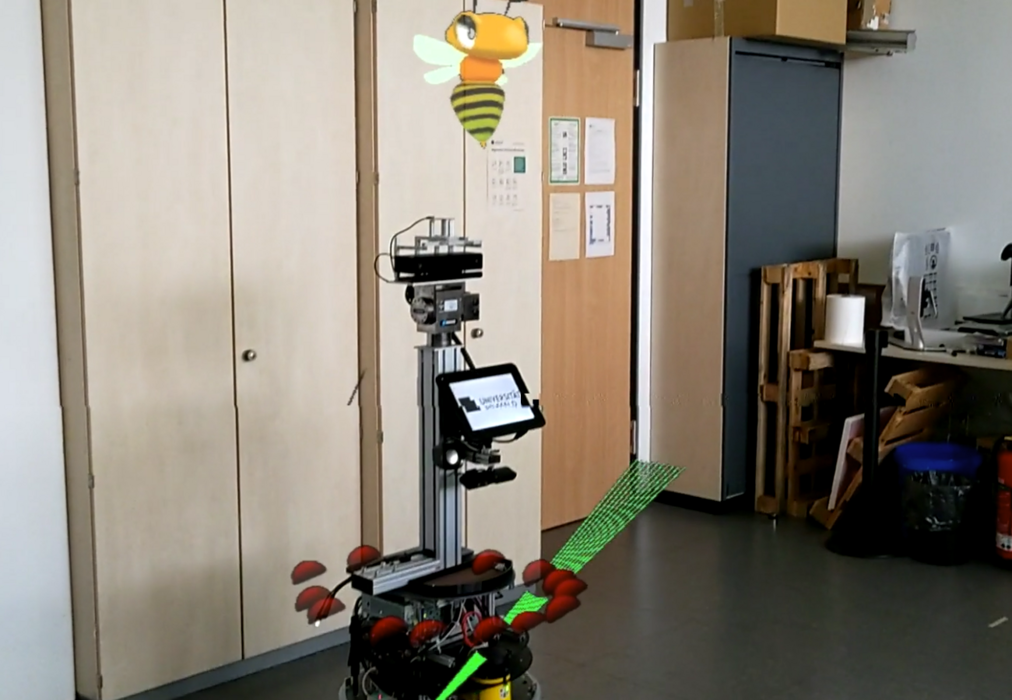

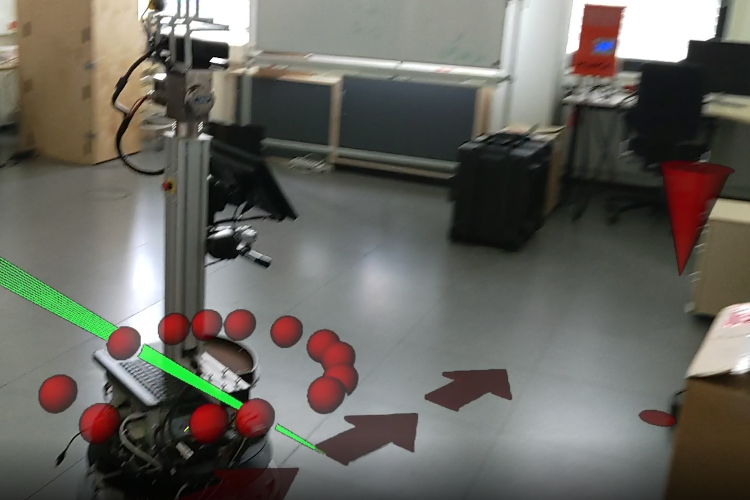

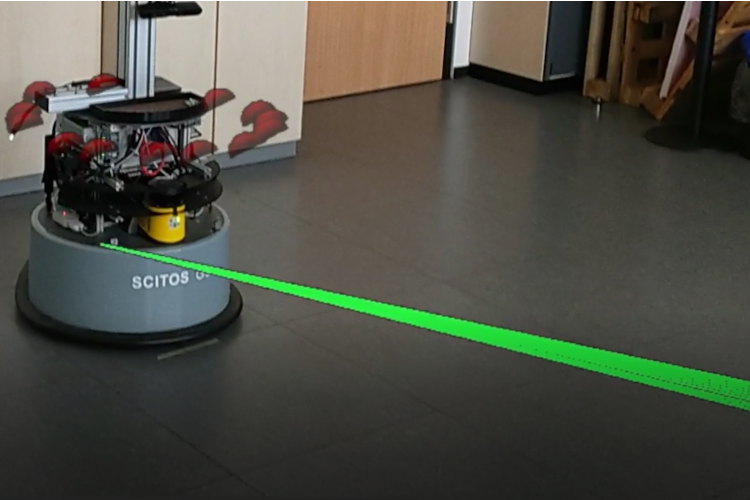

Dafür haben die Informatiker*innen Visualisierungen der Funktionsweise eines Roboters in Augmented Reality (AR) erstellt, die sie einer Gruppe von Nutzer*innen während einer Roboterdemonstration präsentierten. In der Demonstration sollte der Roboter eine Navigationsaufgabe lösen. Die Visualisierungen zeigten die Gründe auf, wenn der Roboter sich unerwartet verhielt, zum Beispiel, wenn er neu planen musste, mit einem Gegenstand zusammenstieß oder sein Ziel nicht erreichte. Eine zweite Gruppe bekam keine Visualisierungen zu sehen. „Die Studie zeigt einen möglichen Zusammenhang zwischen AR-Visualisierungen und Verständnis sowie Vertrauen gegenüber dem Roboter auf. Ob es sich um einen Gewöhnungseffekt oder einen Effekt von Vorwissen handelt, müssen wir in weiteren Studien prüfen“ so Vollmer.

Ihre Studie hat das Team festgehalten im Artikel „Technical Transparency for Robot Navigation Through AR Visualizations“ (deutsch: Technische Transparenz für Roboternavigation durch AR Visualisierungen). Vorgestellt wurde er in der Sparte „Late-Breaking Reports“ (LBR) auf der HRI 2023 vom 13.-16. März in Stockholm, der Konferenz für Mensch-Roboter-Interaktion. Die Konferenz bietet mit den LBR Autor*innen die Möglichkeit, frühe Ergebnisse und neue Ideen zu Spitzenforschung zu präsentieren.

Link zum Paper „Technical Transparency for Robot Navigation Through AR Visualizations“