Erklärungen gemeinsam entwickeln

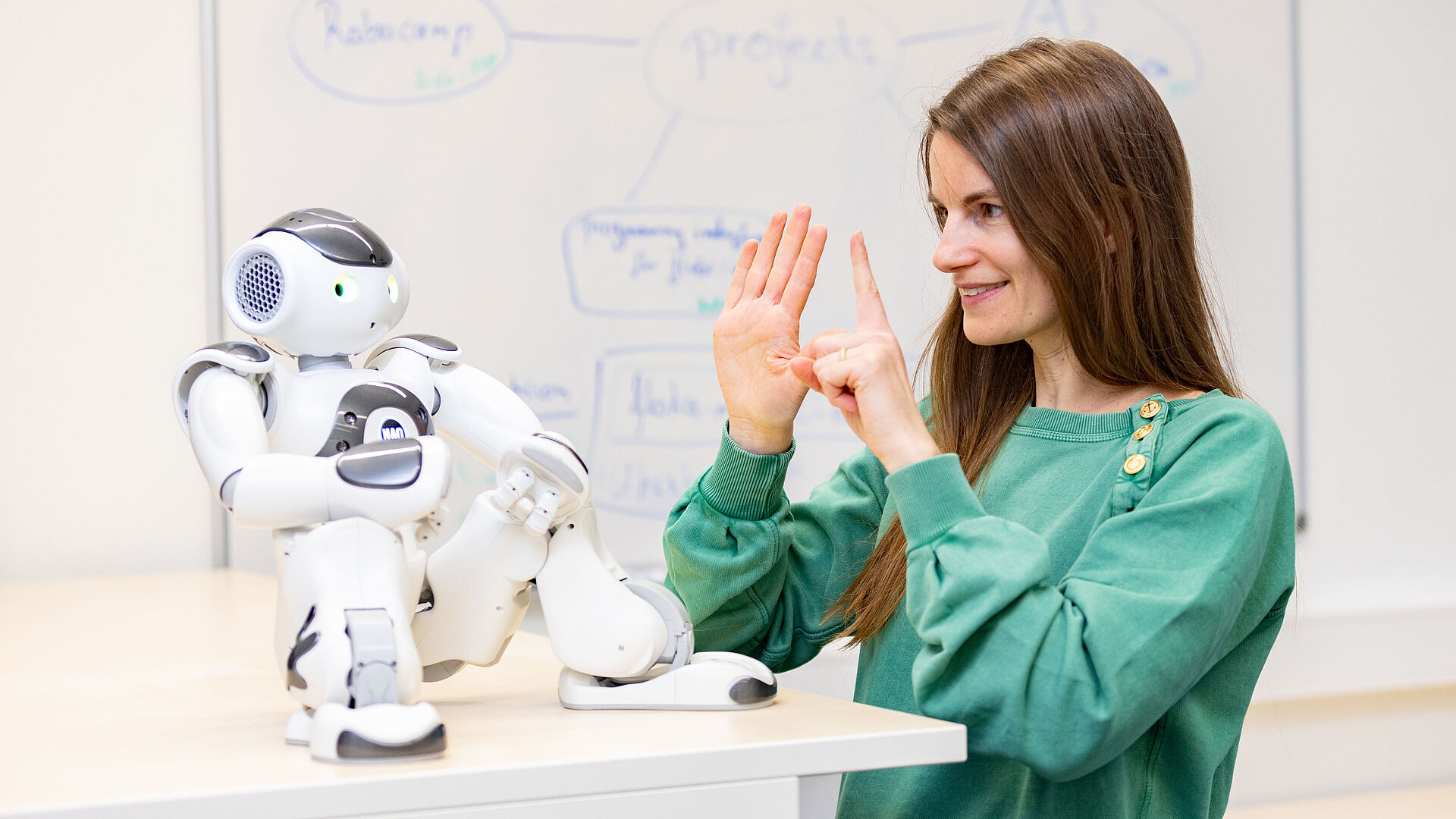

Algorithmische Ansätze wie das maschinelle Lernen werden immer komplexer. Diese zunehmende Undurchsichtigkeit erschwert es, die von Künstlicher Intelligenz (KI) vorgeschlagenen Entscheidungen nachzuvollziehen und zu akzeptieren. Im Sonderforschungsbereich/Transregio 318 „Constructing Explainability“ (Erklärbarkeit konstruieren) entwickeln die Forscher*innen daher Wege, Nutzer*innen aktiv in den Erklärprozess einzubinden und so ko-konstruktive Erklärungen zu ermöglichen. Seit 2021 untersucht das interdisziplinäre Forschungsteam die Prinzipien, Mechanismen und sozialen Praktiken des Erklärens und wie diese bei der Gestaltung von KI-Systemen berücksichtigt werden können. Ziel des Projektes ist es, Nutzer*innen relevante Informationen so bereitzustellen, dass sie fundierte Entscheidungen treffen und sich aktiv wie kritisch an einer digitalen Gesellschaft beteiligen können.

Termine

Publikationen

Alle Publikationen des TRR 318 auf einen Blick: Fachartikel, Konferenzbeiträge und Konferenzabstracts.

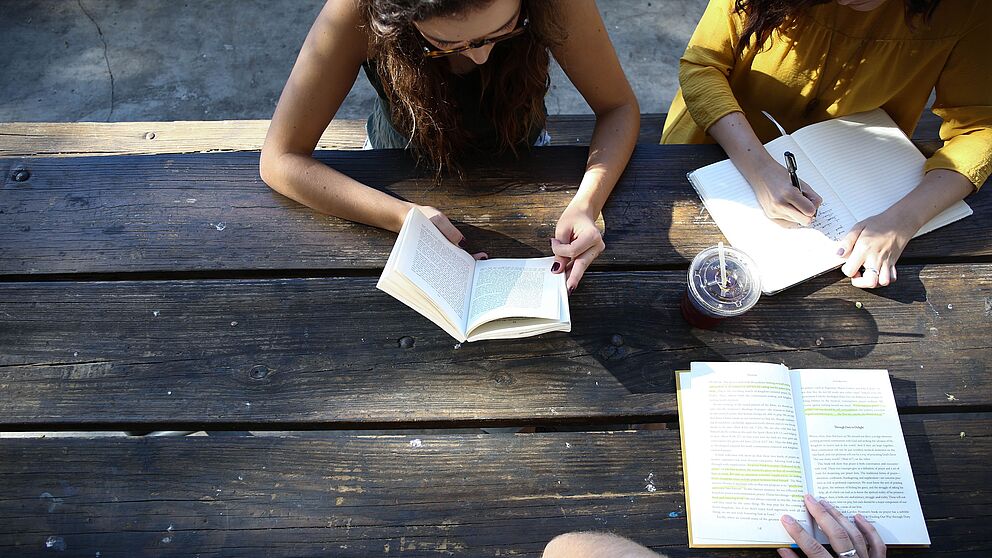

Mitglieder

Die Ko-Konstruktion von Erklärungen untersuchen insgesamt 23 Projektleiter*innen mit rund 40 wissenschaftlichen Mitarbeiter*innen aus Linguistik, Psychologie, Medienwissenschaften, Soziologie, Wirtschaftswissenschaften, Informatik und Philosophie der Universitäten Bielefeld und Paderborn.

Integriertes Graduiertenkolleg

KI-Forum

Medien

Management-Team

Sprecherin - Projektleiterin A01, A05, Z

Büro: TP6.2.304

Telefon: +49 5251 60-5717

E-Mail: katharina.rohlfing@uni-paderborn.de

Web: Homepage

Stellvertretender Sprecher - Projektleiter B01, C05

Telefon: +49 521 10612249

E-Mail: cimiano@techfak.uni-bielefeld.de

Mitglied - Projektleiterin B06

Büro: N2.304

Telefon: +49 5251 60-2432

E-Mail: suzana.alpsancar@uni-paderborn.de

E-Mail: lehrealp@mail.uni-paderborn.de

Web: Homepage

Mitglied - Projektleiter A01, C05

Telefon: +49 521 10612144

E-Mail: skopp@techfak.uni-bielefeld.de

Mitglied - Projektleiterin A03, C02

Büro: Q3.301

Telefon: +49 5251 60-2080

E-Mail: kirsten.thommes@uni-paderborn.de

Web: Homepage

Mitglied - Projektleiter C04, C07

Telefon: +49 511 76212377

E-Mail: h.wachsmuth@ai.uni-hannover.de

Mitglied - Projektleiterin A03, A05, WIKO

Telefon: +49 521 10667885

E-Mail: bwrede@techfak.uni-bielefeld.de

Mitglied - Postdoktorandin A01

Büro: ZM2.B.02.26

E-Mail: josephine.beryl.fisher@uni-paderborn.de

Web: Homepage

Geschäftsführerin - Mitarbeiterin Z - Wissenschaftsmanagement

Büro: ZM2.B.02.01

Telefon: +49 5251 60-4493

E-Mail: ronja.hannebohm@uni-paderborn.de

E-Mail: management@trr318.uni-paderborn.de

Web: Homepage

Lesen Sie mehr über uns: