Projekt C02: Interaktives Lernen von erklärbaren, situationsangepassten Entscheidungsmodellen

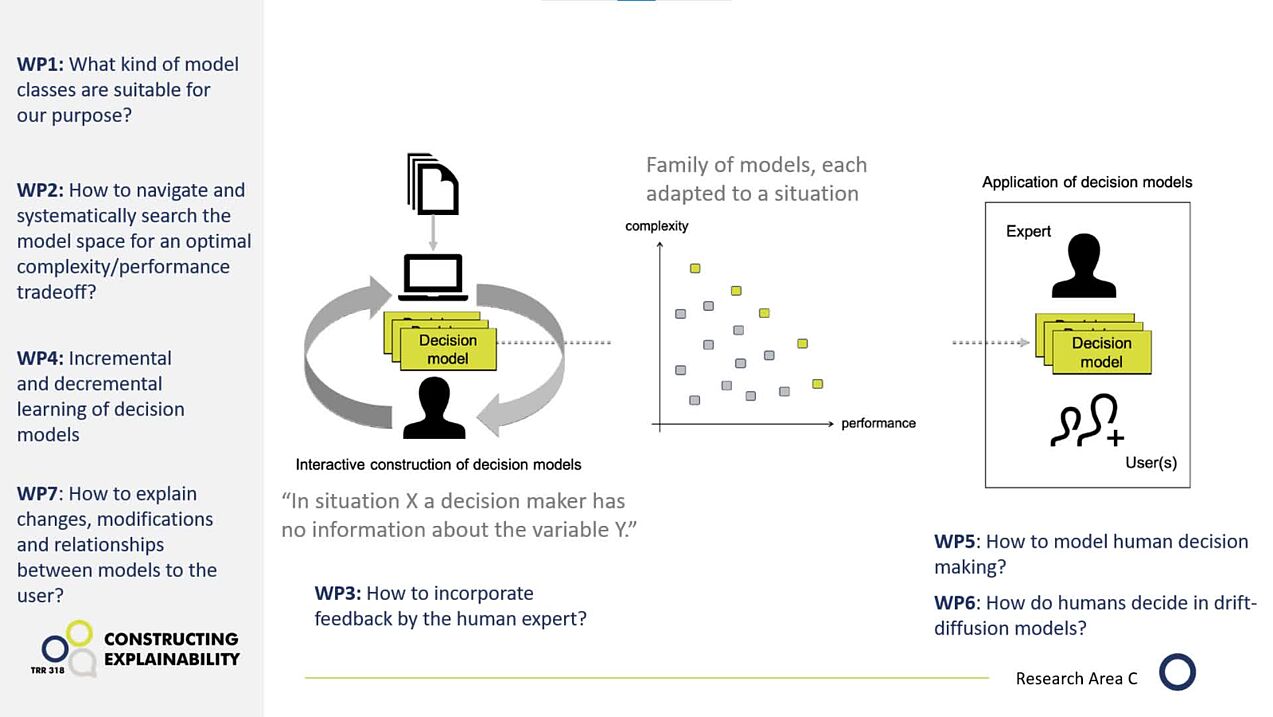

Unterschiedliche Situationen erfordern verschiedene Strategien für die maschinelle Entscheidungsfindung. Im Projekt C02 entwickeln Forschende aus der Informatik und den Wirtschaftswissenschaften preskriptive Modelle, die konkrete Handlungsempfehlungen für den bestmöglichen Nutzen liefern. Zudem untersuchen sie, wann und von wem neue Testfälle ausgewählt werden sollten – von der KI, dem Menschen oder gemeinsam – um die Wissensbasis gezielt zu erweitern und das Lernen zu verbessern. Dieses Vorgehen wird als Exploration bezeichnet und dient dazu, langfristig bessere Ergebnisse zu erzielen.

Das Ziel ist es, Entscheidungsträger*innen zu befähigen, die Empfehlungen der KI im Einklang mit ihrem eigenen Wissen besser einzuordnen, um fundierte und effektive Entscheidungen zu treffen.

Forschungsgebiete: Informatik, Wirtschaftswissenschaften

Assoziiertes Mitglied

Jonas Hanselle, Universität Paderborn

Hilfskräfte

Nils Bojack, Universität Paderborn

Julia Rustemeier, Universität Paderborn

Luca Manuel Siekermann, Universität Paderborn

Ehemalige Mitglieder

Dr. Michael Rapp, Wissenschaftlicher Mitarbeiter

Stefan Heid, Wissenschaftlicher Mitarbeiter

Publikationen

Generation of Explanatory Content and Requirements for Social XAI

K. Främling, K. Thommes, B. Wrede, in: Social Explainable AI, Springer Nature Singapore, Singapore, 2026.

Measuring the Outcome of sXAI

K. Thommes, in: Social Explainable AI, Springer Nature Singapore, Singapore, 2026.

Operationalizing Social Interaction

H. Wachsmuth, K. Thommes, M. Alshomary, in: Social Explainable AI, Springer Nature Singapore, Singapore, 2026.

Exploration of Explaining Content

K. Främling, B. Wrede, K. Thommes, in: Social Explainable AI, Springer Nature Singapore, Singapore, 2026.

Interaction History in Social XAI

K. Thommes, K. Främling, B. Wrede, S. Kubler, in: Social Explainable AI, Springer Nature Singapore, Singapore, 2026.

Evaluation Principles

K. Thommes, in: Social Explainable AI, Springer Nature Singapore, Singapore, 2026.

Algorithm, expert, or both? Evaluating the role of feature selection methods on user preferences and reliance

J. Kornowicz, K. Thommes, Plos One (2025).

Would I regret being different? The influence of social norms on attitudes toward AI usage

J. Kornowicz, M. Pape, K. Thommes, Arxiv (2025).

MSL: Multi-class Scoring Lists for Interpretable Incremental Decision-Making

S. Heid, J. Kornowicz, J. Hanselle, K. Thommes, E. Hüllermeier, in: Communications in Computer and Information Science, Springer Nature Switzerland, Cham, 2025.

An Empirical Examination of the Evaluative AI Framework

J. Kornowicz, International Journal of Human–Computer Interaction (2025) 1–19.

Learning decision catalogues for situated decision making: The case of scoring systems

S. Heid, J.M. Hanselle, J. Fürnkranz, E. Hüllermeier, International Journal of Approximate Reasoning 171 (2024).

Learning decision catalogues for situated decision making: The case of scoring systems

S. Heid, J.M. Hanselle, J. Fürnkranz, E. Hüllermeier, International Journal of Approximate Reasoning 171 (2024).

Human-AI Co-Construction of Interpretable Predictive Models: The Case of Scoring Systems

S. Heid, J. Kornowicz, J.M. Hanselle, E. Hüllermeier, K. Thommes, in: PROCEEDINGS 34. WORKSHOP COMPUTATIONAL INTELLIGENCE, 2024, p. 233.

Towards a Computational Architecture for Co-Constructive Explainable Systems

H. Buschmeier, P. Cimiano, S. Kopp, J. Kornowicz, O. Lammert, M. Matarese, D. Mindlin, A.S. Robrecht, A.-L. Vollmer, P. Wagner, B. Wrede, M. Booshehri, in: Proceedings of the 2024 Workshop on Explainability Engineering, ACM, 2024, pp. 20–25.

The Role of Response Time for Algorithm Aversion in Fast and Slow Thinking Tasks

A. Lebedeva, J. Kornowicz, O. Lammert, J. Papenkordt, in: Artificial Intelligence in HCI, 2023.

Aggregating Human Domain Knowledge for Feature Ranking

J. Kornowicz, K. Thommes, Artificial Intelligence in HCI (2023).

Probabilistic Scoring Lists for Interpretable Machine Learning

J.M. Hanselle, J. Fürnkranz, E. Hüllermeier, in: Discovery Science, Springer Nature Switzerland, Cham, 2023.

Comparing Humans and Algorithms in Feature Ranking: A Case-Study in the Medical Domain

J.M. Hanselle, J. Kornowicz, S. Heid, K. Thommes, E. Hüllermeier, in: M. Leyer, J. Wichmann (Eds.), LWDA’23: Learning, Knowledge, Data, Analysis. , 2023.

Alle Publikationen anzeigen