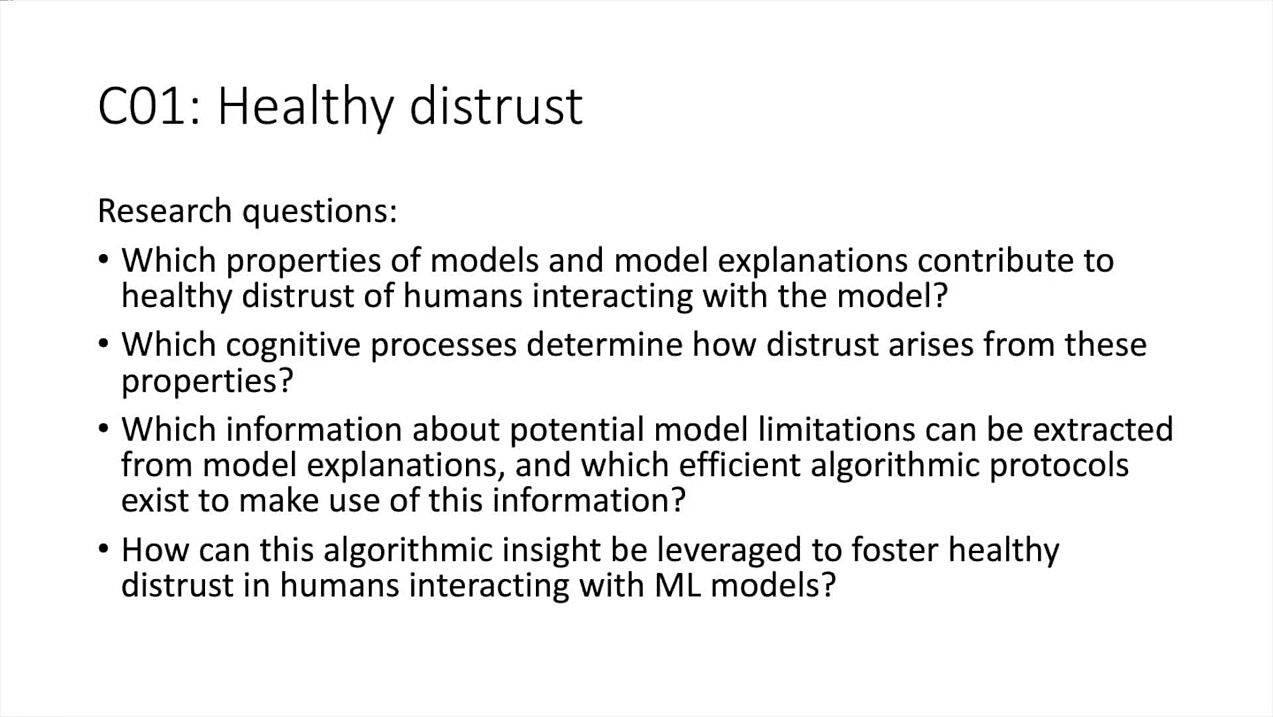

Projekt C01: Erklärungen zur Unterstützung gesunden Misstrauens in Large Language Models

Maschinengelernte Modelle haben prinzipielle Grenzen. Unter anderem deshalb ist es wichtig, die Ergebnisse etwa von Chatbots, die auf Large Language Models (LLMs) beruhen (wie ChatGPT), kritisch zu hinterfragen und ihnen nicht blind zu vertrauen. In der ersten Förderphase des Projekts wurde zunächst eine gemeinsame Sprache für Vertrauen und Misstrauen entwickelt. Eine empirische Untersuchung zeigte, dass Warnhinweise (Disclaimer) nicht ausreichen, um gesundes Misstrauen zu fördern. Daher haben die Projektbeteiligten aus Psychologie und Informatik neue Ansätze entwickelt, um Unsicherheiten von Modellen verständlich zu erklären. Darauf aufbauend entwickelt das Projektteam in der zweiten Förderphase gezielte Maßnahmen, um gesundes Misstrauen zu fördern, insbesondere am Beispiel der Unterstützung durch LLMs beim wissenschaftlichen Schreiben. Eine zentrale Rolle spielen sogenannte „perplexing explanations“, eine neu entwickelte Form von Erklärungen, die die Unzuverlässigkeit von LLMs illustrieren. Diese Erklärungen sollen im TRR 318 auch als automatische Methode eingesetzt werden, um die menschliche Autonomie im Umgang mit KI-Systemen zu stärken.

Forschungsgebiete: Informatik, Psychologie

Hilfskräfte

Valeska Behr, Universität Paderborn

Oliver Debernitz, Universität Paderborn

Ehemalige Mitglieder

Roelof Visser, Wissenschaftlicher Mitarbeiter

Publikationen

Assessing healthy distrust in human-AI interaction: interpreting changes in visual attention

T.M. Peters, K. Biermeier, I. Scharlau, Frontiers in Psychology 16 (2026).

When prediction replaces explanation: A threat to psychological science

M. Knauff, M.V. Butz, B. Kaup, W. Kunde, I. Scharlau, Psyarxiv (2026).

Trust, distrust, and appropriate reliance in (X)AI: A conceptual clarification of user trust and survey of its empirical evaluation

R. Visser, T.M. Peters, I. Scharlau, B. Hammer, Cognitive Systems Research (2025).

Interacting with fallible AI: Is distrust helpful when receiving AI misclassifications?

T.M. Peters, I. Scharlau, Frontiers in Psychology 16 (2025).

Explaining Outliers using Isolation Forest and Shapley Interactions

R. Visser, F. Fumagalli, E. Hüllermeier, B. Hammer, in: Proceedings of the European Symposium on Artificial Neural Networks (ESANN), 2025.

The Importance of Distrust in AI

T.M. Peters, R.W. Visser, in: Communications in Computer and Information Science, Springer Nature Switzerland, Cham, 2023.

“I do not know! but why?” — Local model-agnostic example-based explanations of reject

A. Artelt, R. Visser, B. Hammer, Neurocomputing 558 (2023).

Explaining Reject Options of Learning Vector Quantization Classifiers

A. Artelt, J. Brinkrolf, R. Visser, B. Hammer, in: Proceedings of the 14th International Joint Conference on Computational Intelligence, SCITEPRESS - Science and Technology Publications, 2022.

Model Agnostic Local Explanations of Reject

A. Artelt, R. Visser, B. Hammer, in: ESANN 2022 Proceedings, Ciaco - i6doc.com, 2022.

Alle Publikationen anzeigen